Intersektionella hallucinationer – framtidssäkra syntetiska data

AI:s prestanda är beroende av kvaliteten på dess data. Vid Linköpings universitet undersöks hur syntetiska data kan förbättras för att skapa säkrare och mer inkluderande AI-lösningar. Genom att integrera sociologiska teorier med AI och syntetiska data, leder forskningen vägen för framtidens policy och teknikutveckling.

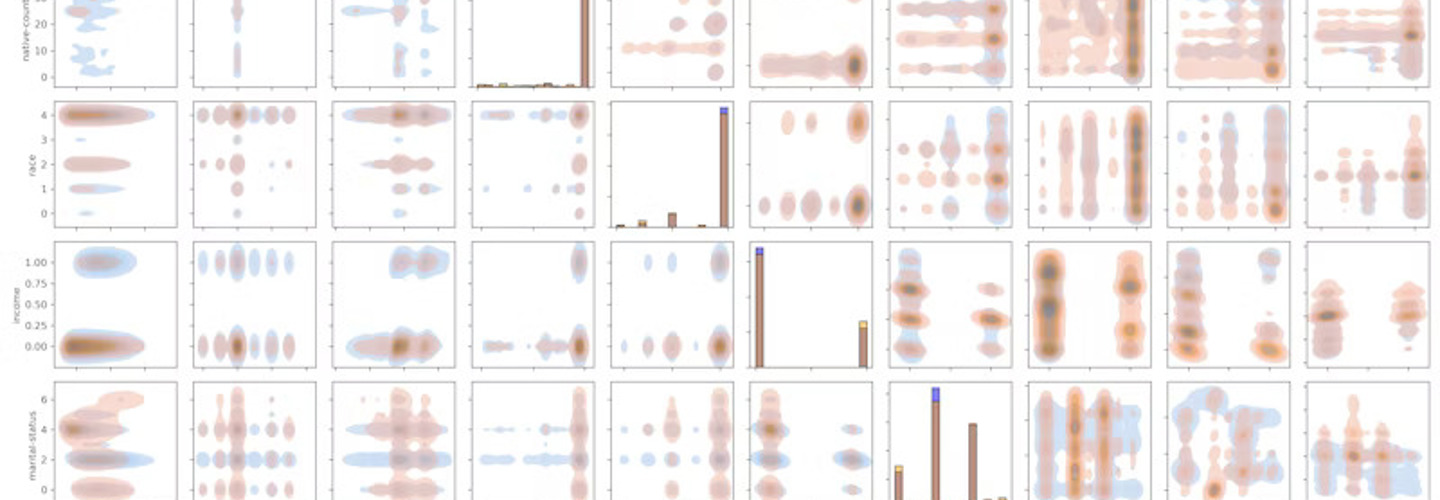

Syntetiska data har potential att skydda integritet och möjliggöra datadelning, men riskerar att förbise minoritetsgrupper och komplexa relationer, och att skapa ”intersektionella hallucinationer.” Vår forskning kombinerar sociologiska representationsteorier med maskininlärning för att utveckla syntetiska data som bättre speglar verklighetens komplexitet. Genom att identifiera och kartlägga dessa hallucinationer kan vi skapa mer exakta syntetiska dataset och undvika felaktiga klassificeringar. Vi höjer kvaliteten på syntetiska och säkerställer deras användbarhet inom kommersiella och offentliga sektorer, samtidigt som vi främjar hållbara och inkluderande AI-lösningar.